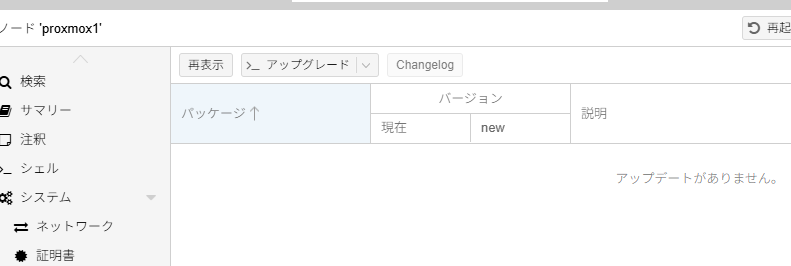

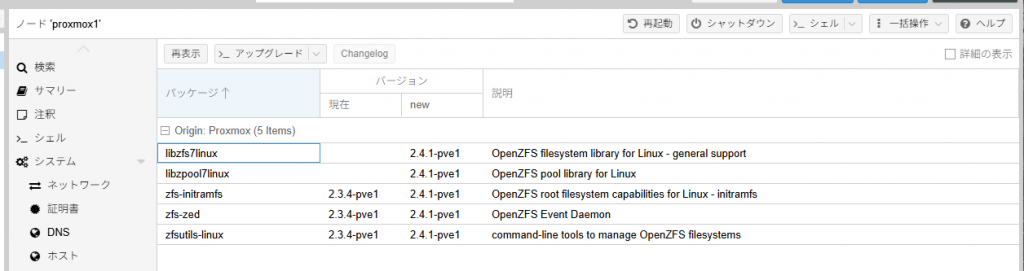

Proxmox VE 9.1環境で、sshログインして「apt upgrade -y」でアップデートしたんだけど、GUIでみると下記の様にパッケージが残っていた

sshログインして「apt upgrade」を実行した場合は以下の結果

root@proxmox1:~# apt upgrade

Not upgrading:

zfs-initramfs zfs-zed zfsutils-linux

Summary:

Upgrading: 0, Installing: 0, Removing: 0, Not Upgrading: 3

root@proxmox1:~#

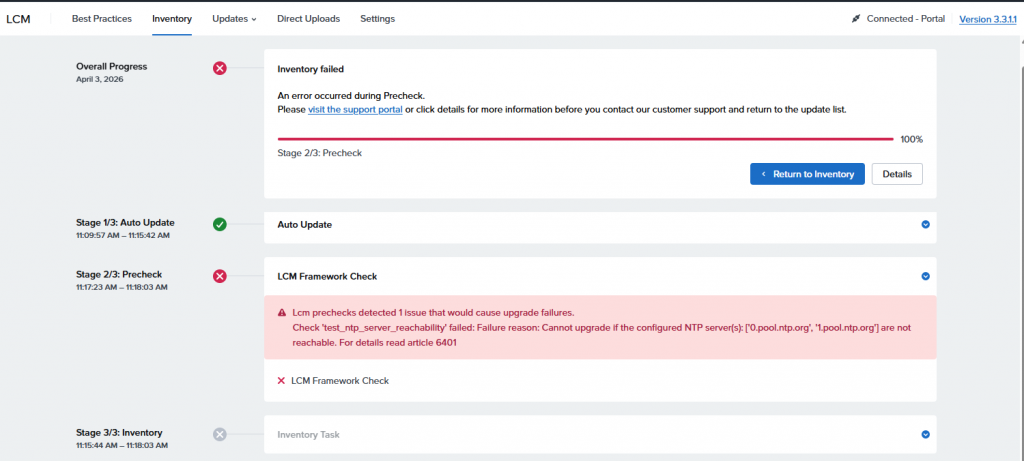

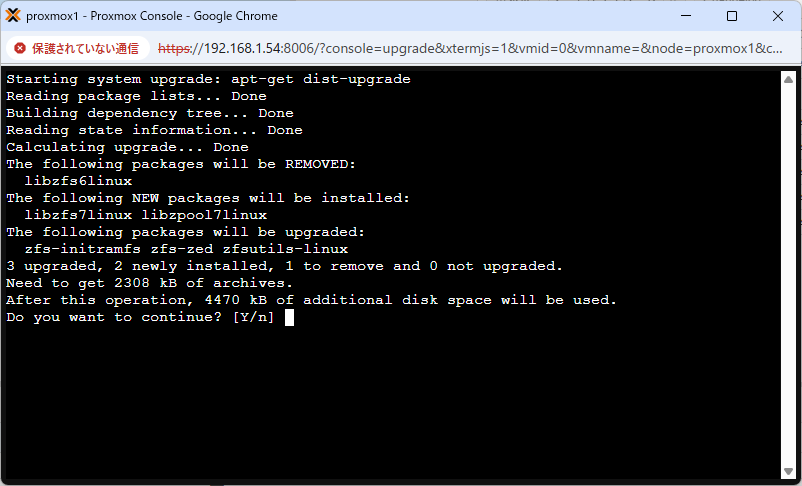

しかし、Web GUI上の「アップグレード」をクリックすると、

上記の様な表示が出る・・・実行しているコマンドが「apt-get dist-upgrade」となっている

おや?と思って、マニュアルを再確認してみる

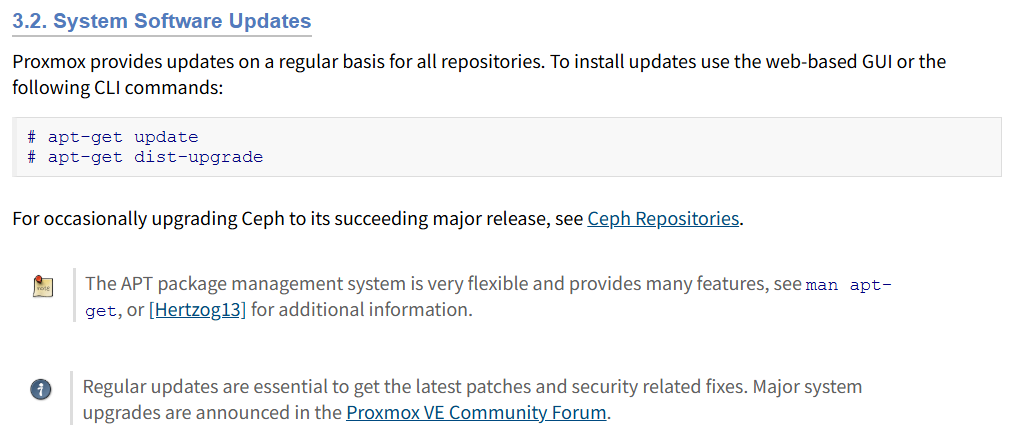

「3.2. System Software Updates」によると・・・

「apt-get update」を実行したあと「apt-get dist-upgrade」を実行しろ、とあった

というわけで「apt dist-upgrade」コマンドを実行

root@proxmox1:~# apt dist-upgrade

Upgrading:

zfs-initramfs zfs-zed zfsutils-linux

Installing dependencies:

libzfs7linux libzpool7linux

REMOVING:

libzfs6linux

Summary:

Upgrading: 3, Installing: 2, Removing: 1, Not Upgrading: 0

Download size: 2,308 kB

Space needed: 4,470 kB / 31.8 GB available

Continue? [Y/n] y

Get:1 http://download.proxmox.com/debian/pve trixie/pve-no-subscription amd64 zfs-initramfs all 2.4.1-pve1 [26.8 kB]

Get:2 http://download.proxmox.com/debian/pve trixie/pve-no-subscription amd64 zfsutils-linux amd64 2.4.1-pve1 [596 kB]

Get:3 http://download.proxmox.com/debian/pve trixie/pve-no-subscription amd64 zfs-zed amd64 2.4.1-pve1 [71.0 kB]

Get:4 http://download.proxmox.com/debian/pve trixie/pve-no-subscription amd64 libzfs7linux amd64 2.4.1-pve1 [226 kB]

Get:5 http://download.proxmox.com/debian/pve trixie/pve-no-subscription amd64 libzpool7linux amd64 2.4.1-pve1 [1,388 kB]

Fetched 2,308 kB in 2s (935 kB/s)

Reading changelogs... Done

(Reading database ... 76859 files and directories currently installed.)

Preparing to unpack .../zfs-initramfs_2.4.1-pve1_all.deb ...

Unpacking zfs-initramfs (2.4.1-pve1) over (2.3.4-pve1) ...

Preparing to unpack .../zfsutils-linux_2.4.1-pve1_amd64.deb ...

Unpacking zfsutils-linux (2.4.1-pve1) over (2.3.4-pve1) ...

Preparing to unpack .../zfs-zed_2.4.1-pve1_amd64.deb ...

Unpacking zfs-zed (2.4.1-pve1) over (2.3.4-pve1) ...

(Reading database ... 76862 files and directories currently installed.)

Removing libzfs6linux:amd64 (2.3.4-pve1) ...

Removing 'diversion of /lib/x86_64-linux-gnu/libzfs_core.so.3 to /lib/x86_64-linux-gnu/libzfs_core.so.3.usr-is-merged by libzfs6linux'

Removing 'diversion of /lib/x86_64-linux-gnu/libzfs_core.so.3.0.0 to /lib/x86_64-linux-gnu/libzfs_core.so.3.0.0.usr-is-merged by libzfs6linux'

Selecting previously unselected package libzfs7linux:amd64.

(Reading database ... 76850 files and directories currently installed.)

Preparing to unpack .../libzfs7linux_2.4.1-pve1_amd64.deb ...

Unpacking libzfs7linux:amd64 (2.4.1-pve1) ...

Selecting previously unselected package libzpool7linux:amd64.

Preparing to unpack .../libzpool7linux_2.4.1-pve1_amd64.deb ...

Unpacking libzpool7linux:amd64 (2.4.1-pve1) ...

Setting up libzpool7linux:amd64 (2.4.1-pve1) ...

Setting up libzfs7linux:amd64 (2.4.1-pve1) ...

No diversion 'diversion of /lib/x86_64-linux-gnu/libzfs_core.so.3 to /lib/x86_64-linux-gnu/libzfs_core.so.3.usr-is-merged by libzfs6linux', none removed.

No diversion 'diversion of /lib/x86_64-linux-gnu/libzfs_core.so.3.0.0 to /lib/x86_64-linux-gnu/libzfs_core.so.3.0.0.usr-is-merged by libzfs6linux', none removed.

Setting up zfsutils-linux (2.4.1-pve1) ...

Installing new version of config file /etc/default/zfs ...

Installing new version of config file /etc/zfs/zfs-functions ...

zfs-import-scan.service is a disabled or a static unit, not starting it.

Setting up zfs-initramfs (2.4.1-pve1) ...

Setting up zfs-zed (2.4.1-pve1) ...

Processing triggers for libc-bin (2.41-12+deb13u2) ...

Processing triggers for man-db (2.13.1-1) ...

Processing triggers for initramfs-tools (0.148.3) ...

update-initramfs: Generating /boot/initrd.img-7.0.2-2-pve

Running hook script 'zz-proxmox-boot'..

Re-executing '/etc/kernel/postinst.d/zz-proxmox-boot' in new private mount namespace..

No /etc/kernel/proxmox-boot-uuids found, skipping ESP sync.

root@proxmox1:~#

これで、アップデートしていないパッケージはなくなった

root@proxmox1:~# apt update

Hit:1 http://security.debian.org/debian-security trixie-security InRelease

Hit:2 http://deb.debian.org/debian trixie InRelease

Hit:3 http://deb.debian.org/debian trixie-updates InRelease

Hit:4 http://download.proxmox.com/debian/ceph-squid trixie InRelease

Hit:5 http://download.proxmox.com/debian/pve trixie InRelease

All packages are up to date.

root@proxmox1:~#