Proxmoxで仮想マシンを作った場合、仮想マシンのsnapshotの作られ方が仮想マシンを置く場所(データストア)によって異なっている。

zfsについては簡単に確認できたが、それ以外についてどうなるのかを確認した。

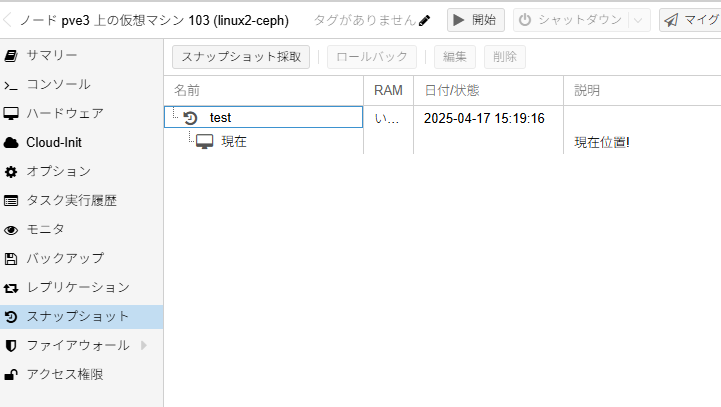

まず、proxmoxのWeb UIからスナップショットを作成した

これをコマンドで確認していく

まず、Proxmox VE側のコマンドで仮想マシンにsnapshotがあるかどうかは「qm listsnapshot <VMID>」を実行して確認できる。これは各ファイルシステムで共通となる。

root@pve3:~# qm listsnapshot 103

`-> test 2025-04-17 15:19:16 no-description

`-> current You are here!

root@pve3:~#

次に各ファイルシステムごとにそれぞれ確認していく手法が違う。

ZFSの場合

例えばzfsの場合であれば 「zfs list -t snapshot」で確認できる。

root@pve3:~# qm listsnapshot 101

`-> zfs-test-snap 2025-04-17 15:39:18 no-description

`-> current You are here!

root@pve3:~# zfs list -t snapshot

NAME USED AVAIL REFER MOUNTPOINT

rpool/data/vm-101-disk-0@zfs-test-snap 0B - 139K -

rpool/data/vm-101-disk-1@zfs-test-snap 0B - 22.8G -

rpool/data/vm-101-disk-2@zfs-test-snap 0B - 22.1M -

rpool/data/vm-101-disk-3@zfs-test-snap 0B - 85.2K -

root@pve3:~#

NFSの場合

NFSの場合、仮想マシンをqcow2形式で作成した場合のみsnapshot作成が可能となる。

まず仮想マシンの設定を確認

root@pve3:~# qm config 105

agent: 1

boot: order=sata0;ide0;ide2;net0

cores: 2

cpu: x86-64-v2-AES

ide0: none,media=cdrom

ide2: none,media=cdrom

machine: pc-i440fx-9.2+pve1

memory: 2048

meta: creation-qemu=9.2.0,ctime=1744345484

name: wintest3-nfs

net0: e1000=BC:24:11:FD:D4:F3,bridge=vmbr0,firewall=1

numa: 0

ostype: win10

parent: nfs-snap

sata0: ontap:105/vm-105-disk-0.qcow2,size=40G

scsihw: virtio-scsi-single

smbios1: uuid=7a3e58d8-be9e-4e03-a040-bd1635aa3dfe

sockets: 1

vmgenid: f361fff2-f474-4260-99ac-586c42db009b

root@pve3:~# qm listsnapshot 105

`-> nfs-snap 2025-04-17 15:39:29 no-description

`-> current You are here!

root@pve3:~#

該当する領域をlsコマンドで確認

root@pve3:~# ls -l /mnt/pve/ontap/images/105

total 13607536

-rw-r----- 1 root root 45504004165 Apr 17 15:36 vm-105-disk-0.qcow2

root@pve3:~#

見た目には1ファイルしかないように見える。

このファイルに対して「qemu-img snapshot -l ファイル名」を実行するとsnapshotが作成されているかどうかがわかる。

root@pve3:~# qemu-img snapshot -l /mnt/pve/ontap/images/105/vm-105-disk-0.qcow2

Snapshot list:

ID TAG VM_SIZE DATE VM_CLOCK ICOUNT

1 nfs-snap 0 B 2025-04-17 15:39:29 0000:00:00.000 0

root@pve3:~#

cephの場合

cephの場合、rbdコマンドのオプションでいろいろ指定していくのだが、確認がちょっとめんどい

まずは、仮想マシンの設定を「qm config <VMID>」を実行して確認する。

root@pve3:~# qm config 103

agent: 1

boot: order=scsi0;ide2;net0

cores: 2

cpu: x86-64-v2-AES

ide2: none,media=cdrom

memory: 2048

meta: creation-qemu=9.2.0,ctime=1744338514

name: linux2-ceph

net0: virtio=BC:24:11:3A:D1:9E,bridge=vmbr0,firewall=1

numa: 0

ostype: l26

parent: test

scsi0: cephpool:vm-103-disk-0,iothread=1,size=40G

scsihw: virtio-scsi-single

smbios1: uuid=37f0d81e-3ed1-417a-9a10-3d8f556e3b37

sockets: 1

vmgenid: 0ea7ac3f-7b05-49d0-90c0-fbba87cc63ae

root@pve3:~# qm listsnapshot 103

`-> test 2025-04-17 15:19:16 no-description

`-> current You are here!

root@pve3:~#

scsi0の行にある「cephpool」が使用しているデータストア名となる。

Ceph RDBが使用しているOSD Pool名を「ceph osd pool ls」を実行して確認する

root@pve3:~# ceph osd pool ls

.mgr

cephpool

cephfs_data

cephfs_metadata

root@pve3:~#

cephfs_dataとcephfs_metadataはCeph FSのほうで使っているデータで、仮想マシンをおくデータストアはcephpool のほうとなる。

cephpoolにある仮想マシン用のディスクを「rbd ls cephpool」で確認する

root@pve3:~# rbd ls cephpool

vm-103-disk-0

root@pve3:~#

この仮想マシンについて、snapshotが作成されているかは「rbd snap ls cephpool/<仮想ディスク名>」で確認する

root@pve3:~# rbd snap ls cephpool/vm-103-disk-0

SNAPID NAME SIZE PROTECTED TIMESTAMP

10 test 40 GiB Thu Apr 17 15:19:16 2025

root@pve3:~#